Das Forschungsteam „KARE“

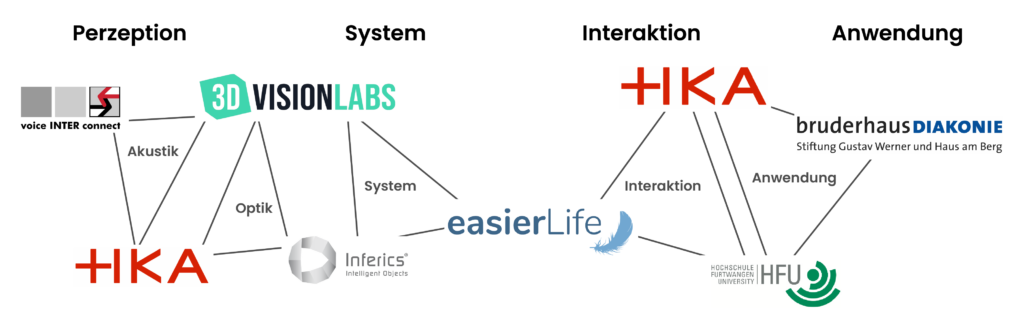

Die Hochschule Karlsruhe (HKA) ist eine der größten und forschungsstärksten Hochschulen Baden-Württembergs. Im Projekt KARE übernimmt die HKA die Projektleitung und die Rolle eines Wissenschaftspartners mit Beiträgen zur optischen und akustischen Perzeption, Aktivitätsanalyse und Interaktion. So übernimmt sie in enger Abstimmung mit BruderhausDiakonie und der HFU methodische Arbeiten zur Interaktion und bringt sich bei der akustischen Perzeption ein. Gemeinsam mit Inferics und voice INTER connect bearbeitet sie zudem die methodischen Arbeiten zur Aktivitätsanalyse auf Basis akustischer und optischer Perzeption.

Die HKA wird im Projekt KARE von Prof. Dr. Matthias Wölfel und Frau Prof. Dr.-Ing. Astrid Laubenheimer vertreten. Herr Wölfel ist Professor für Intuitive und Perzeptive Benutzungsschnittstellen und fokussiert im Projekt Fragestellungen im Bereich der akustischen Perzeption und der Mensch-Maschine-Interaktion. Für das geplante Vorhaben sind insbesondere die Vorarbeiten aus den aktuell laufenden Projekten SAM sowie InstAgT relevant. Frau Laubenheimer ist Sprecherin der Intelligent Systems Research Group (ISRG) der HKA, in der Kompetenzen im Bereich Computer Vision, Maschinelles Lernen und Optimierung gebündelt werden. Für das geplante Vorhaben sind insbesondere die Vorarbeiten aus den Projekten HyperMod, WISO3D, InferMod3D und Q-AMeLiA relevant, letzteres u.a. im Verbund mit der Inferics GmbH.

Am Institut Mensch, Technik und Teilhabe (IMTT) der Hochschule Furtwangen werden anwendungsnahe interdisziplinäre Forschungsprojekte an der Schnittstelle zwischen Mensch, Technik und gesellschaftlicher Teilhabe bearbeitet. Zu den Forschungsschwerpunkten zählen u.a. der Technikeinsatz in der Pflege, die Unterstützung von pflegerischen Versorgungsprozessen (Case- und Care-Management), digitale Interventionen zur Gesundheitsförderung und technische Assistenzsysteme zur Förderung der Teilhabe für ältere Menschen und Menschen mit Behinderungen. Kennzeichnend für das IMTT ist die enge Verzahnung technik- und pflegewissenschaftlicher Kompetenzen. Im Institut arbeiten Wissenschaftlerinnen und Wissenschaftler aus den Ingenieurwissenschaften, der Informatik, der Pädagogik sowie den Gesundheits- und Pflegewissenschaften interdisziplinär in den Projekten zusammen. Geleitet wird das IMTT von Prof. Dr. Peter König (Pflege- und Rehabilitationsmanagement) und Prof. Dr. Christophe Kunze (Digitale Gesundheitstechnologien). In unseren Projekten arbeiten wir mit einem großen Netzwerk an Praxispartner:innen aus dem Sozial- und Gesundheitswesen zusammen. Aufgaben:

- Bedarfserhebung

- Gestaltung partizipativer Forschungsprozesse

- Evaluation in der Versorgungspraxis

- Organisation der ethischen Forschungsbegleitung

Die Inferics GmbH wurde 2018 gegründet, um durch Einbettung von KI in Objekte intelligente Räume und Arbeits- und Lebensassistenten zu schaffen. Ihre Gründer sind ausgewiesene Forscher der KI für mit mehr als 40 wissenschaftlichen Publikationen. Die Inferics war an Quick-Check Projekten des KI-Fortschrittszentrum “Lernende Systeme” beteiligt sowie am Exploring Project VeriPos in Kooperation mit dem CyberValley Tübingen-Stuttgart, zur Robustifizierung der Posenschätzung durch Regularisierung mit A-priori-Wissen. Die Ergebnisse wurden veröffentlicht. Inferics unterstützt ferner das Projekt Q-AMeLiA, das u.a. von der HKA bearbeitet wird. Bei Inferics wurden zwei für das Projekt relevante Master-Abschlussarbeiten durchgeführt. Im BMBF-Projekt KInterACT (bis Anfang 2021) wurde gemeinsam mit dem Verbundpartner 3dvisionlabs GmbH die Hardware- und Software-Plattform PatronuSens gelegt, die in KARE weiterentwickelt werden soll. Im Verbundvorhaben „Embedded NeuroVision“ hat Inferics bis Ende 2021 die Verwendung sogenannter Event-Kameras und Neuromorpher Neuronaler Netze (Neuronale Netze dritter Generation) für die Aktivitätserkennung erforscht. Ein Work-In-Progress-Paper hierüber wurde für die Lecture Notes in Informatics der GI eingereicht. Inferics verfügt somit über die Vorerfahrung, die technischen Voraussetzungen und das Know-How für die erfolgreiche Umsetzung der Projektaufgaben.

Aufgaben im Projekt:

- Mit-Erhebung der Anforderungen an das Perzeptionssystem von KARE und Formalisierung der Anforderungen an die 3D-Posenschätzung und die 3D-Video-basierte Aktivitätsklassifikation.

- Entwicklung von modularen und hierarchischen KI-Methoden und -Modellen für die

- 3D-Posenschätzung und für die

- 3D-Video-basierte Aktivitätsklassifikation,

welche besonders ressourcenschonend den Anforderungen genügen und eine Ressourcenteilung mit anderen KI-Modellen ermöglichen.

Die easierLife GmbH ist ein innovatives Unternehmen im Bereich Health-IT aus der Technologieregion Karlsruhe. Wir haben die Vision, älteren Menschen bis ins hohe Alter ein unabhängiges und selbstbestimmtes Leben zu Hause zu ermöglichen. Mit Hilfe von smarten Notruflösungen für unterwegs und zuhause unterstützen unsere Systeme im Alltag und bringen Familien näher zusammen. Dabei stehen Sicherheit und Assistenz im Vordergrund. Wie legen großen Wert darauf, die eingesetzte Technik für alle Zielgruppen nutzbar zu machen. Kostengünstige, technologieunabhängige und einfach nutzbare Technik soll im Alltag unterstützen ohne weitere Hürden zu errichten.

Die easierLife GmbH übernimmt die Rolle des Systemintegrators und wird ihre bereits im Markt etablierte Cloud-Infrastruktur an die spezifischen Anforderungen des KARE-Projekts anpassen. Diese Cloud-Infrastruktur wird als Backend-Lösung die Verbindung zwischen der Sensorik für die präzise Perzeption relevanter Situationen und den daraus abgeleiteten Interaktionen bilden. Hierfür wird der KARE-Sensor in das ambiente Sensornetzwerk der easierLife GmbH integriert. Durch Interpretation der vorliegenden Situation wird durch entsprechende Algorithmen im Backend entschieden, ob und wie eine multimodale Interaktion mit dem Pflegeempfangenden und/oder mit autorisierten Pflegenden erfolgen soll. Die easierLife GmbH wird die Anwendungspartner bei der Evaluierung der Projektergebnisse von technischer Seite unterstützen, insbesondere bei der Anpassung bereits bestehender und der Implementierung neuer Prozesse.

Die 3dvisionlabs GmbH ist seit der Gründung 2017 ein Technologiedienstleister im Bereich innovativer kamerabasierter 2D- und 3D-Sensorsysteme für KI Anwendungen. 3dvisionlabs wird im Konsortium die Entwicklung und Erforschung der visuellen Komponente des Perzeptionssystems übernehmen.

voice INTER connect (VIC) liefert als Technologie-Experte Lösungen für Sprachbedienung, Akustik und digitale Sprachkommunikation sowie Freisprechen und Geräuschunterdrückung.

Kommunikationsprodukte sind seit 2001 unser tägliches Geschäft. Als Entwicklungs- und Integrationspartner begleiten wir unsere Kunden mit innovativen Ideen, umfangreichem Know-how und ergebnisorientierter Arbeitsweise von der Projektidee bis zur Serienfertigung.

Einsatzbereite Elektronikmodule, langjährige Erfahrungen in Märkten wie Nutzfahrzeuge, Medizintechnik und Industrieautomation sowie unser 30-köpfiges interdisziplinäres Expertenteam sind die Voraussetzungen dafür, dass wir in Projekten ökonomisch und schnell das Entwicklungsziel erreichen und so unsere Kunden nachhaltig begeistern.

Der Schwerpunkt aktueller Forschungsarbeiten liegt in einer robusten Spracherfassung, -interpretation und natürlicher Sprachinteraktion mit dem Nutzer in realen Umgebungen mit Störgeräuschen, Raumhall, bewegten Sprechern und natürlicher Spontansprache.

Technologien wie akustische Sprachquellen-Lokalisierung im Raum, Sprecherverfolgung durch 3D Audiosensoren (Mikrofon-Arrays) sowie Hochleistungs-Sprachbereinigung durch Umweltmodellierung, Geräuschklassifikation und -filterung mittels KI-Systemen sollen auch im KARE-Projekt erforscht und weiterentwickelt werden. Für eine intuitive und berührungslose Interaktion mit dem KARE-Assistenz-System und eine proaktive Ansprache des Pflegeempfängers kommen Spracherkennungstechnologien mit natürlichem Sprachverständnis sowie ein Sprachausgabesystem (Text-to-Speech) zum Einsatz.

VIC erarbeitet im Rahmen von KARE einen miniaturisierten, akustischen 3D Sensor mit einer Schnittstelle zum Vision-System von 3dvisionlab und Inferics, welcher im Raum oder auf dem mobilen Assistenten installiert werden kann und die Sensorschnittstelle zum KARE-Assistenzsystem und zum Alarmserver darstellt.

Die BruderhausDiakonie Stiftung Gustav Werner und Haus am Berg in Baden-Württemberg blickt auf eine 150-jährige Geschichte zurück. Unsere Angebote umfassen vielfältige Assistenz- und Unterstützungsleistungen für Kinder, Jugendliche und Erwachsene. Wir sind in den Bereichen Altenhilfe, Behindertenhilfe, Jugendhilfe, Sozialpsychiatrie, Arbeit und berufliche Bildung tätig.

Rund 5000 Mitarbeiterinnen und Mitarbeiter arbeiten gemeinsam an dem Ziel „Teil haben. Teil sein.“ an Arbeit, Bildung, Heimat und Gesellschaft für alle Menschen zu ermöglichen. Die Altenhilfe unterstützt 3000 ältere Menschen mit 6 Sozialstationen, 22 Seniorenzentren mit stationärer Pflege, Kurzzeitpflege, Tagespflege und offenen Angeboten sowie 21 Betreuten Wohnanlagen bzw. Wohnen mit Service mit 416 Appartements.

Die BruderhausDiakonie ist an verschiedenen Projekten beteiligt, um sich mit dem Thema Digitalisierung interdisziplinär und wissenschaftlich auseinanderzusetzen und gleichzeitig Praxiserfahrungen im Umgang mit technischen Lösungen zu sammeln und weiterzugeben. Das hybride KI-basierte Assistenzsystemen KARE bieten ein großes Potenzial, die Lebensqualität und Teilhabe von Senioren und Seniorinnen zu fördern und gleichzeitig, zum Wohle aller in der Pflege, entwickelt und eingesetzt zu werden.